2026-04-10 北京时间

引言:AI写作助手已成技术新基建

在2026年的内容创作领域,AI写作助手已从“辅助工具”全面升级为“生产力核心”-8。全球AI创意写作助手市场正以21.4%的年复合增长率高速扩张,预计2026年将达26.7亿美元-44。这背后离不开大语言模型(Large Language Model,LLM)技术的迭代突破。

多数开发者和内容创作者在实际使用中,仍停留在“输入→输出”的浅层交互层面——会调用API、会填提示词,却对背后的运行原理一问三不知。当面试官问及“AI写作助手底层依赖哪些技术”“Transformer如何支撑文本生成”时,回答往往支离破碎。本文将带你从概念原理到代码示例再到面试考点,完整打通AI写作助手的技术链路。

一、基础信息配置

文章标题:2026-04-10 一文讲透AI写作助手AI杰西:核心原理到面试考点

目标读者:技术入门/进阶学习者、在校学生、面试备考者、相关技术栈开发工程师

文章定位:技术科普 + 原理讲解 + 代码示例 + 面试要点,兼顾易懂性与实用性

写作风格:条理清晰、由浅入深、语言通俗、重点突出

一、痛点切入:为什么需要AI写作助手

先看一段传统文本生成的实现方式:

传统模板式生成 def generate_article_template(template, data): """基于模板填充内容""" return template.replace("{{title}}", data["title"]) \ .replace("{{body}}", data["body"])

这种方式的三大痛点:

内容僵化:模板固定,无法根据上下文动态调整语气和风格

扩展性差:每新增一种文体,就要写一套模板逻辑

缺乏理解:机器只是“填空”,对语义、逻辑、情感完全无感

传统实现方式的痛点,恰好说明了AI写作助手出现的设计初衷:让机器真正“理解”写作任务,而非机械填充。

二、核心概念:大语言模型(LLM)

定义:大语言模型是参数量巨大(通常在十亿级以上)、在大规模文本语料上预训练的深度神经网络,能够理解自然语言并生成连贯、上下文相关的文本内容。

关键词拆解:

“大”:参数量达十亿甚至万亿级别

“预训练”:在海量通用文本上先“学会”语言基本规律

“生成”:根据给定输入,预测并输出最可能的后续内容

生活化类比:想象一个在图书馆读了几百万本书的人。他不是死记硬背每本书的内容,而是通过海量阅读学会了语言的规则、逻辑和表达方式。当你给他一个开头,他能自然地把故事续写下去。

核心价值:让AI写作助手真正具备“理解”和“创作”能力,从根本上颠覆传统模板式内容生产。

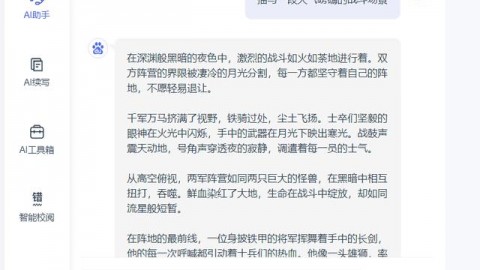

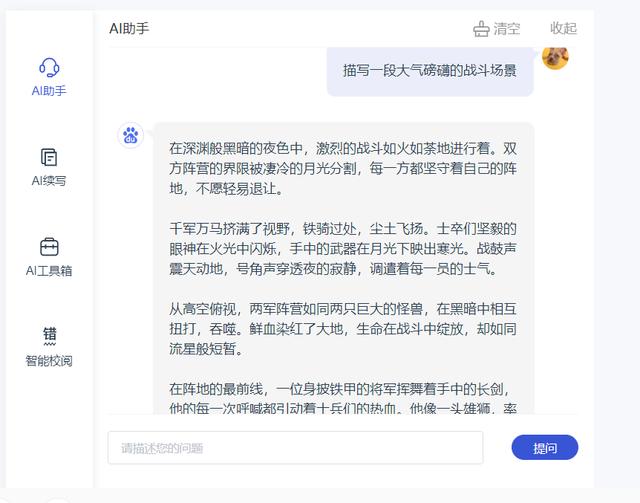

三、关联概念:AI写作助手

定义:AI写作助手是基于大语言模型技术,面向内容创作场景提供智能化写作辅助的工具产品,涵盖文案生成、润色改写、风格调整、长文创作等功能。

它与大语言模型的关系:

| 维度 | 大语言模型 | AI写作助手 |

|---|---|---|

| 角色 | “发动机” | “整车” |

| 层级 | 底层基础设施 | 上层应用产品 |

| 能力 | 通用文本生成 | 场景化写作服务 |

| 示例 | GPT-4、Claude、DeepSeek | Jasper、Notion AI、豆包 |

一句话概括:大语言模型是AI写作助手的“大脑”,AI写作助手是大语言模型的“应用外壳”。

四、概念关系总结:思想 vs 落地

二者逻辑关系清晰:

大语言模型:回答“如何让机器理解并生成语言”这一根本问题

AI写作助手:回答“如何将这一能力落地到写作场景”这一工程问题

大语言模型提供了可能性,AI写作助手完成了产品化——两者协同,共同推动内容创作进入智能化新时代。

五、代码示例:极简文本生成实现

import torch from transformers import AutoTokenizer, AutoModelForCausalLM 加载预训练模型和分词器 model_name = "microsoft/DialoGPT-medium" tokenizer = AutoTokenizer.from_pretrained(model_name) model = AutoModelForCausalLM.from_pretrained(model_name) def simple_text_generate(prompt, max_length=100): """ 基于LLM的文本生成函数 核心逻辑:将输入文本编码 → 模型推理 → 解码输出 """ 步骤1:将提示词转换为模型可处理的token序列 inputs = tokenizer.encode(prompt, return_tensors="pt") 步骤2:模型自回归生成(逐个token预测) outputs = model.generate( inputs, max_length=max_length, pad_token_id=tokenizer.eos_token_id, do_sample=True, 启用采样,增加多样性 temperature=0.7 控制随机性,值越小越确定 ) 步骤3:将生成的token序列解码为自然语言文本 return tokenizer.decode(outputs[0], skip_special_tokens=True) 运行示例 result = simple_text_generate("人工智能写作助手的核心优势在于") print(result)

执行流程:编码(tokenize) → 模型推理(predict) → 解码(decode),三步完成从提示词到完整文本的生成。

六、底层原理与技术支撑

AI写作助手的技术根基建立在三大支柱之上:

1. Transformer架构

2017年Google提出的Transformer架构,通过自注意力机制彻底改变了序列建模方式。其核心突破在于:

并行计算:不像RNN必须逐个处理token,Transformer可一次性处理整个序列

长距离依赖:自注意力机制能捕捉文本中任意两个位置的关联

2. 自注意力机制(Self-Attention)

让模型在生成每个词时,“关注”输入序列中所有词,并给不同词分配不同权重。例如生成“苹果很好吃”时,“好吃”会更多关注“苹果”而非“很”。

3. 混合专家架构(Mixture of Experts,MoE)

将模型参数拆分至多个专业“专家模块”(如逻辑推理专家、语言润色专家、事实核查专家),生成时动态调用对应模块,响应延迟低至50ms-8。

七、高频面试题与参考答案

Q1:大语言模型(LLM)的核心技术架构是什么?

参考答案:LLM基于Transformer解码器架构,核心组件包括:①自注意力机制:捕捉词与词之间的长距离依赖关系;②多头注意力:从不同子空间并行学习语义特征;③前馈神经网络:对注意力输出做非线性变换;④残差连接与层归一化:缓解梯度消失、加速收敛。GPT系列、Claude、Llama等主流模型均采用此架构。

Q2:文本生成时,“温度”(Temperature)参数起什么作用?

参考答案:Temperature控制模型输出概率分布的锐度。值越小(趋近0),高概率token被强化,输出更确定性、更保守;值越大(如1.0以上),低概率token被放大,输出更多样但可能偏离逻辑。在AI写作中,正式公文建议用低温度,创意写作建议用高温度。

Q3:什么是自回归生成?与传统模板生成有何区别?

参考答案:自回归生成指模型逐个预测下一个token,每步的输出成为下一步的输入。与传统模板填充不同,自回归生成:①具有上下文记忆;②能动态调整后续输出;③生成的内容是连续推理的结果,而非预设替换。

八、结尾总结

回顾全文核心要点:

大语言模型是AI写作助手的底层“大脑”,提供文本理解与生成能力

AI写作助手是面向场景的上层产品,将LLM能力落地到写作应用

Transformer+自注意力是支撑这一切的底层架构

代码示例演示了从提示词到生成文本的完整三步流程

重点提醒:初学者最容易混淆的是“会调用API”与“懂原理”之间的差距。面试中,能说出“Temperature控制采样分布”远不如“能画出Transformer自注意力的计算图”——后者才是真正理解的表现。

下一篇我们将深入Transformer自注意力机制的数学实现,从矩阵运算层面彻底搞懂“每个词如何关注其他词”。

参考资料

[1] 2026年度最佳AI写作工具|从技术内核拆解10款神器,重构内容创作效率. 今日惠州网, 2026-02-27.-8

[2] 2026年全球人工智慧(AI)創新寫作助理市場報告. The Business Research Company.-44

[3] 写作软件真实数据曝光:2026办公写作软件前十强盘点及场景适配分析. 行业资讯, 2026-03-20.-50

[4] Meta打碎Transformer 8年铁律!改写AI最底层规则. 澎湃新闻, 2025-10-28.-