达尔文AI助手深度解析:一文读懂进化式编程技术

在AI编程工具遍地开花的今天,大多数AI助手仍然受限于固定的、由人类设计的架构——它们可以帮你补全代码、解答问题,但永远无法超越人类预设的程序。这种“只会用、不懂原理”的现状,让很多开发者和学习者在面试时答不出底层机制、在实际应用中遇到瓶颈。本文将围绕

一、痛点切入:传统AI助手的“天花板”

先看一个典型场景。假设你在使用一个普通AI助手来帮你修复代码bug:

用户输入:“帮我修复这个Python函数,它总是返回None” def calculate_discount(price, is_vip): if is_vip: discount = 0.2 return price discount 非VIP用户忘了写返回值!

传统AI助手的回答通常是:“建议在第3行后添加 return price discount”。它识别出了语法缺失,但仅此而已。

传统AI助手的三大痛点:

被动响应,无法主动进化:它只能根据预训练的固定知识回答问题,无法自主发现并修复自身能力的局限。

每次改进依赖人工:AI助手本身无法自我优化,要升级必须等工程师重新训练或更新模型。

缺乏持续的自我迭代:即使学会了修复这个bug,下一次遇到类似问题仍需要重复同样的推理路径,没有形成“学习—积累—迭代”的闭环。

这些问题催生了AI智能体自我进化的需求。达尔文AI助手正是在这一背景下诞生的——它不是普通的聊天机器人,而是一套能让AI通过重写自身代码来不断进化的智能体系统。

二、核心概念讲解:达尔文哥德尔机(Darwin Gödel Machine, DGM)

标准定义

达尔文哥德尔机(Darwin Gödel Machine, DGM) 是由哥伦比亚大学研究团队提出的新型AI自我改进系统,它以“编码智能体”为优化对象,通过迭代方式修改自身代码,并利用编码基准对每项修改进行实证验证-11。

关键词拆解

| 关键词 | 含义 |

|---|---|

| 达尔文 | 借鉴生物进化思想:产生变异→验证适应性→优胜劣汰 |

| 哥德尔 | 指哥德尔机的理论框架:系统可以修改自身 |

| 机(Machine) | 可运行的AI系统,而非纯理论构想 |

生活化类比

把DGM想象成一个会自我升级的自动驾驶系统。普通AI助手就像一台普通轿车——出厂时配置固定,功能不变。而DGM则像一辆能识别自身不足、自动下载更新、甚至自己编写补丁的智能汽车。今天它发现高速变道不够平稳,明天它就自己改进了变道算法,后天又拿昨天的改进成果去继续优化更复杂的操作。这个过程循环往复,能力持续攀升。

作用与价值

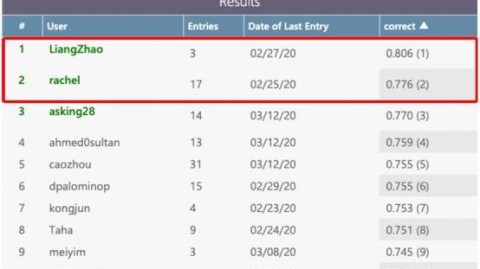

DGM的核心价值在于:首次实现了AI系统以持续、开放的方式修改自身代码,进而实现自我经验验证和迭代式自我改进-12。在SWE-bench基准测试上,其成绩从20.0%提升至50.0%,在Polyglot基准上从14.2%提升至30.7%-11。

三、关联概念讲解:哥德尔机(Gödel Machine, GM)

标准定义

哥德尔机(Gödel Machine) 是由德国计算机科学家于尔根·施密德胡伯于2007年提出的理论型AI构想。它是一种能够通过数学证明来寻找自我改进方法的理论型AI系统——理论上可以自我修改代码,但每次修改都必须通过数学证明来验证有效性-12。

它与DGM的关系

哥德尔机(GM) 是理论构想,强调“数学证明”;

达尔文哥德尔机(DGM) 是实践落地,改用“经验验证”。

两者差异对比

| 维度 | 哥德尔机(GM) | 达尔文哥德尔机(DGM) |

|---|---|---|

| 性质 | 理论构想 | 实践落地的算法系统 |

| 验证方式 | 数学证明 | 基准测试经验验证 |

| 可行性 | 实操困难,证明复杂 | 可落地,已有开源实现 |

| 进化逻辑 | 理论自洽但难以扩展 | 开放式的迭代演化 |

| 效率 | 无实证数据 | 编码能力提升30%-150% |

简单示例说明运行机制

DGM维护一个“生成式编码智能体档案库”,从中采样现有智能体,在其基础上创建“全新、更有趣、且性能更好的”新版本智能体,并通过编码基准测试验证其改进效果-11。

四、概念关系与区别总结

一句话记忆:哥德尔机是“应该怎么做”的理论蓝图,达尔文哥德尔机是“实际做出来了”的实现方案。

二者逻辑关系可以概括为:GM是“目标”,DGM是“手段”。GM提出了自我改进AI的数学理想,DGM放弃了不切实际的数学证明要求,转而通过经验验证让这一理想变得可操作、可执行-12。

对比速记表:

| 概念 | GM(哥德尔机) | DGM(达尔文哥德尔机) |

|---|---|---|

| 关键词 | 理论·证明 | 实践·进化 |

| 验证依据 | 数学严格证明 | 基准测试经验 |

| 实现状态 | 理论构想 | 已开源落地 |

五、代码 / 流程示例演示

极简示例:模拟DGM的“生成-验证-迭代”闭环

DGM的运行遵循“生成-验证-迭代”的闭环逻辑:系统首先从编码智能体档案库中选取初始智能体,利用基础模型生成多个代码变体,然后通过编码基准进行验证,保留有效的改进-。

以下是一个极简Python示例,模拟DGM的核心思想:

import random 模拟编码智能体档案库 agent_archive = [ {"id": "v1", "code": "def solve(): return 0", "score": 0.2}, {"id": "v2", "code": "def solve(): return 5", "score": 0.4}, {"id": "v3", "code": "def solve(): return 8", "score": 0.6}, ] def run_benchmark(agent): """运行编码基准测试,返回性能分数""" 模拟:代码返回的数字越接近10,分数越高 result = eval(agent["code"].split("return")[1].strip()) return 1.0 - abs(result - 10) / 10 def mutate(agent): """对智能体代码进行随机变异(模拟自我修改)""" base_value = eval(agent["code"].split("return")[1].strip()) new_value = base_value + random.uniform(-2, 2) new_code = f"def solve(): return {new_value:.2f}" return {"id": f"{agent['id']}_mutated", "code": new_code, "score": 0} def darwin_iteration(archive, iterations=10): """DGM的一次迭代:生成 → 验证 → 择优保留""" for _ in range(iterations): 步骤1:从档案库中采样一个智能体 parent = random.choice(archive) 步骤2:生成变体(模拟自我修改代码) child = mutate(parent) 步骤3:验证(运行基准测试) child["score"] = run_benchmark(child) 步骤4:择优保留(分数高于最低分则加入档案库) if child["score"] > min(a["score"] for a in archive): 移除当前最低分智能体 archive.sort(key=lambda x: x["score"]) archive.pop(0) archive.append(child) print(f"迭代 {_+1}: 新智能体 {child['id']} 加入档案库,分数={child['score']:.2f}") return archive 运行DGM模拟 print("初始档案库:") for agent in agent_archive: print(f" {agent['id']}: score={agent['score']}") print("\n开始迭代进化...") final_archive = darwin_iteration(agent_archive.copy(), iterations=15) print("\n最终档案库:") for agent in sorted(final_archive, key=lambda x: x["score"], reverse=True): print(f" {agent['id']}: code={agent['code']}, score={agent['score']:.2f}")

执行流程解读:

档案库存储了不同版本的编码智能体及其基准测试分数;

变异模拟AI通过修改自身代码产生新的候选版本;

验证通过编码基准测试对新版本进行评估;

择优保留只保留分数更高的版本,淘汰差的变体。

这个过程模拟了DGM的“开放式演化”机制——通过不断迭代,智能体的编码能力逐步提升。

六、底层原理 / 技术支撑点

DGM的技术实现依赖以下几个底层基础:

1. 固化基座模型(Frozen Foundation Model, FM)

DGM由一个“固化的基座模型”驱动,该模型能够借助工具实现代码的读取、编写与执行功能-11。基座模型本身参数固定,但DGM通过在其外围构建“进化层”来实现能力提升。

2. 开放式探索(Open-Ended Exploration)

DGM会维护一棵不断扩展的智能体树,在空间内对多条不同路径进行并行探索,这与传统的贪婪或梯度下降有本质区别-11。

3. 经验验证替代形式化证明

哥德尔机要求每次修改必须有数学证明来保证正确性,这在实践中几乎不可行。DGM放弃了这一要求,转而通过编码基准测试的实证结果来验证改进的有效性-12。

4. 安全防护机制

所有实验采取了沙箱隔离、人工监督等安全防护措施,确保AI在安全可控的环境中进行自我修改-11。

这些底层技术共同支撑了DGM的自我进化能力。更进一步的技术细节(如智能体感知、规划、记忆、工具调用等六大核心子系统的实现)将在后续文章详细展开。

七、高频面试题与参考答案

面试题1:什么是达尔文哥德尔机(DGM)?它解决了什么问题?

标准答案(三个得分点):

定义:DGM是由哥伦比亚大学研究团队提出的AI自我改进系统,以编码智能体为优化对象,通过迭代修改自身代码,并利用编码基准进行经验验证-11。

解决的问题:传统AI系统受限于人类设计的固定架构,无法自主持续改进-11。DGM首次实现了“以持续、开放的方式修改自身代码”的自我进化能力-12。

效果:在SWE-bench上性能从20.0%提升至50.0%,编码能力提升约150%-11。

面试题2:DGM和哥德尔机(GM)有什么区别?

标准答案(三个对比维度):

| 对比项 | 哥德尔机(GM) | 达尔文哥德尔机(DGM) |

|---|---|---|

| 验证方式 | 数学证明 | 基准测试经验验证 |

| 可落地性 | 理论构想,实操困难 | 已开源实现,可运行 |

| 核心思想 | 形式化自洽性 | 生物进化式迭代 |

一句话总结:GM是理论蓝图,DGM是实践落地-12。

面试题3:DGM的“生成-验证-迭代”闭环是如何运作的?

标准答案(三步流程):

生成:从编码智能体档案库中采样初始智能体,利用基础模型生成多个代码变体-;

验证:通过编码基准测试评估新变体的性能-12;

迭代:将有效改进加入档案库,移除低分变体,继续下一轮生成-11。

该机制借鉴了达尔文进化论的自然选择原理:产生变异→试验适应性→筛选保留-12。

面试题4:DGM的底层依赖了哪些关键技术?

标准答案(四个要点):

固化基座模型(FM) :提供基础的代码理解与生成能力-11;

开放式探索机制:维护智能体树,支持多条进化路径并行-11;

经验验证体系:用基准测试替代数学证明,解决形式化验证的不现实问题-12;

安全防护:沙箱隔离与人工监督保障自我修改的安全性-11。

八、结尾总结

核心知识点回顾

| 知识点 | 一句话总结 |

|---|---|

| 传统AI痛点 | 固定架构,无法自主进化 |

| DGM定义 | 通过修改自身代码实现自我改进的AI系统 |

| 核心机制 | 生成→验证→迭代 闭环 |

| 验证方式 | 基准测试经验验证(非数学证明) |

| 与GM的关系 | GM是理论蓝图,DGM是实践落地 |

| 底层依赖 | 基座模型 + 开放式探索 + 安全防护 |

重点与易错点提醒

⚠️ 不要混淆DGM与普通AI助手:普通AI助手是“用AI解决问题”,DGM是“让AI进化自身能力”,这是根本区别。

⚠️ 注意验证方式的差异:哥德尔机强调数学证明,DGM改用经验验证,这是从理论到实践的关键跨越。

⚠️ 记住核心数据:SWE-bench从20%到50%,Polyglot从14.2%到30.7%,这些数据是面试中的关键得分点。

下篇预告

下一篇将深入讲解DGM的六大核心子系统——感知(Perception)、规划(Planning)、记忆(Memory)、工具调用(Tool Calling)、反思(Reflection)与协作(Coordination) ,并给出可直接运行的完整代码示例-。敬请关注!